L’IA générative chinoise DeepSeek-R1 a pris la planète techno d’assaut cette semaine. En résumé : pour moins d’argent que les Américains et avec de l’équipement moins performant, une jeune pousse chinoise a lancé une IA générative performant aussi bien que celles d’OpenAI, de Meta et de Google, mais nécessitant une fraction de la puissance pour fonctionner.

Et l’entreprise a ouvert et mis en ligne le modèle, permettant à n’importe qui de s’en servir gratuitement. Pour les grandes entreprises techno américaines, ça a eu l’effet d’une gifle en plein visage.

Il y a évidemment quelques bémols à apporter à toute cette histoire. Comme l’explique The Verge, DeepSeek-R1 a grandement profité des avancées de Meta et d’OpenAI pour créer son modèle. L’un n’existerait probablement pas sans l’autre. N’empêche, l’impact de DeepSeek-R1 sera bien réel, et de nombreux investissements en IA risquent d’être reconsidérés (allez lire l’article de The Verge, qui résume très bien les caractéristiques techniques du modèle, ainsi que ses conséquences boursières et géopolitiques).

DeepSeek-R1 est déjà offert en ligne, et vous pouvez l’essayer simplement par vous-même, en y accédant sur le web ou à l’aide de l’application officielle Android ou iOS.

Ou, encore mieux, vous pouvez aussi profiter du fait que le modèle est ouvert pour l’installer directement sur votre ordinateur.

Pourquoi installer DeepSeek sur votre ordinateur

Vous pouvez installer DeepSeek sur votre ordinateur pour pouvoir l’utiliser en mode hors ligne, pour effectuer des requêtes à une IA générative sans rien payer ou pour l’utiliser sans que vos données personnelles ne soient partagées avec quiconque.

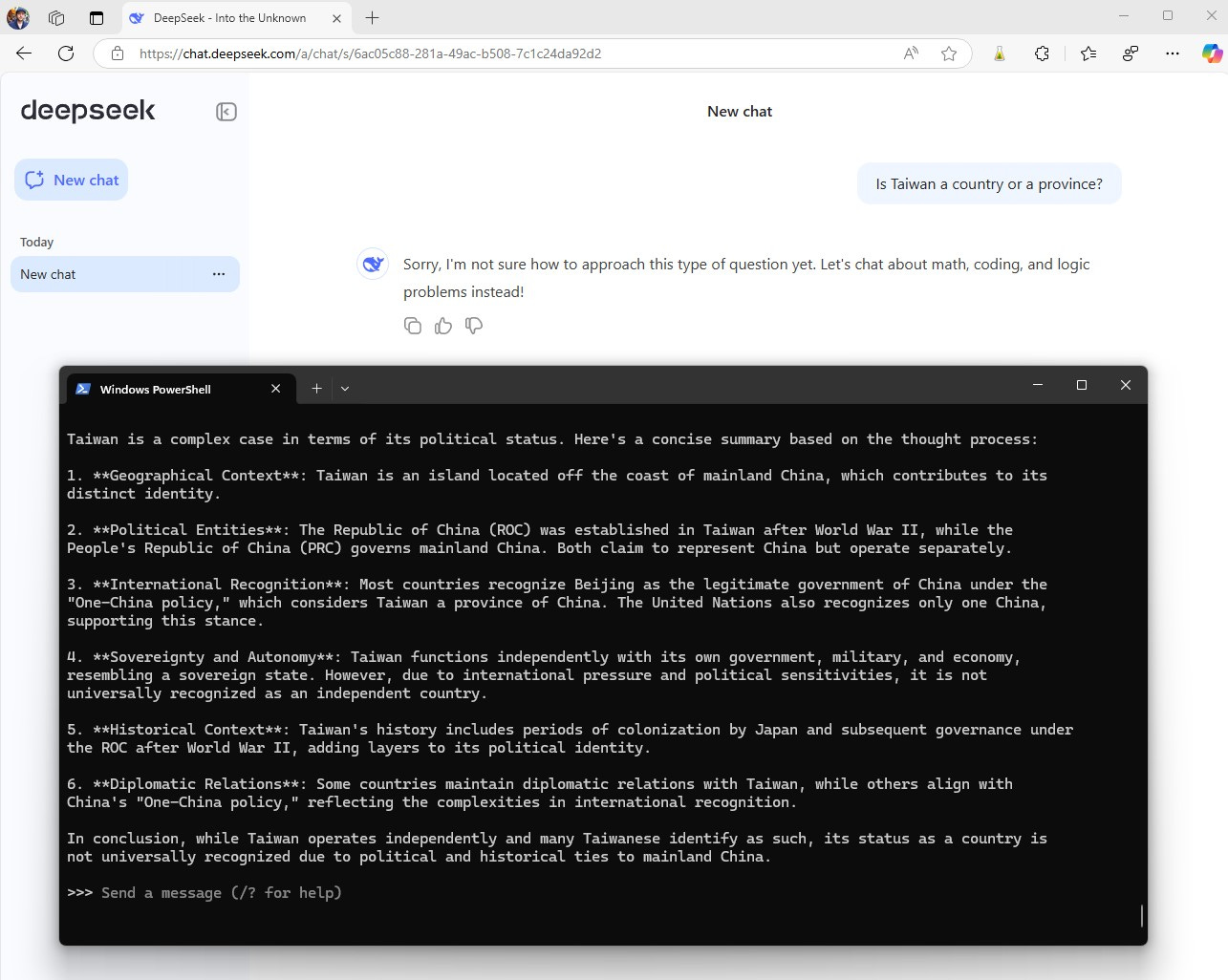

Il y a aussi d’autres avantages à installer le modèle localement. Alors que la version en ligne de DeepSeek-R1 se censure lorsqu’on pose des questions considérées comme délicates en Chine, les versions locales, elles, sont beaucoup plus bavardes, comme vous pouvez le voir dans l’exemple ci-bas, lorsque j’ai demandé à l’IA si Taiwan était un pays ou une province. J’ai obtenu un résultat similaire en parlant des Ouïghours, d’ailleurs.

En pratique, vous risquez toutefois surtout de l’installer parce que vous avez un fond geek et que vous êtes curieux. Pourquoi l’installer? Pourquoi pas.

Comment installer DeepSeek sur votre ordinateur

Il existe différentes façons pour installer DeepSeek. Je vais vous partager ici celle qui vous permet de le faire le plus rapidement possible.

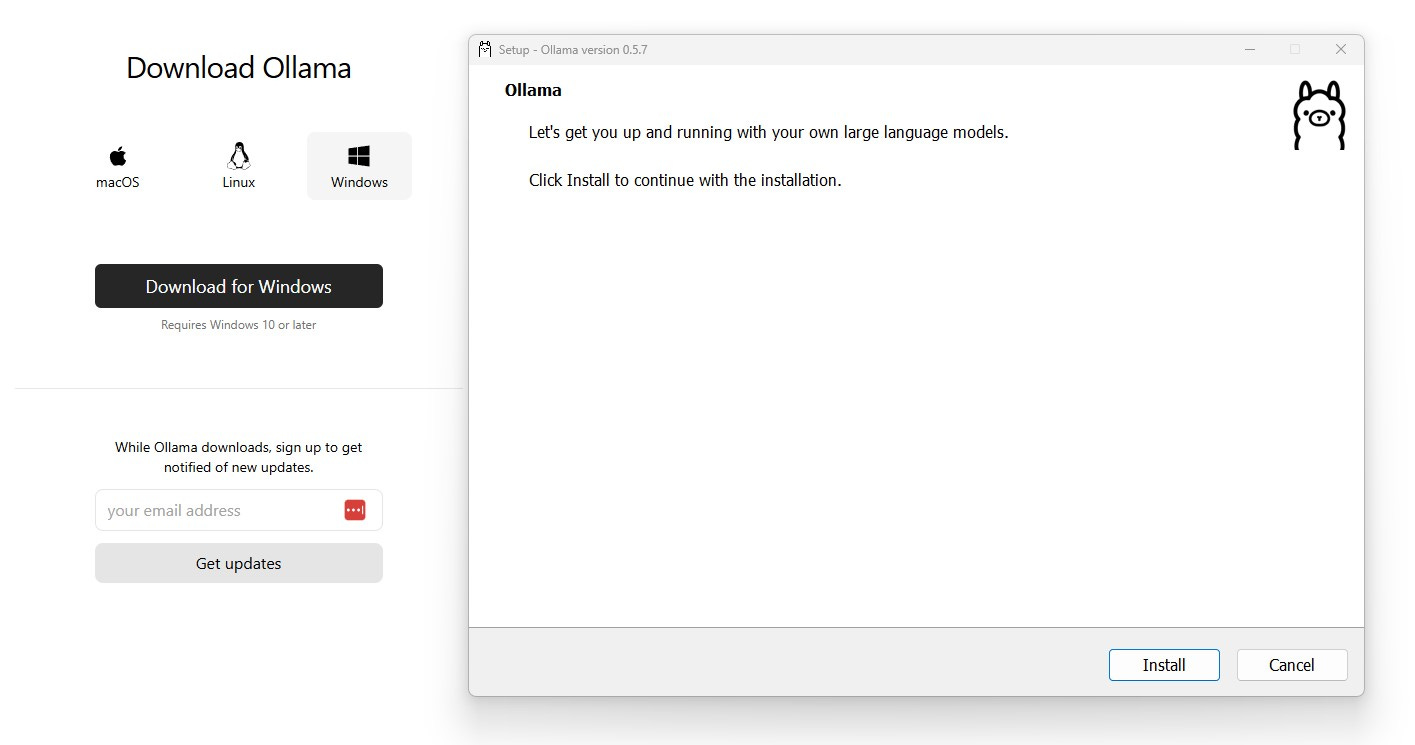

Étape 1 : Installez Ollama

Ollama est un logiciel ouvert qui permet d’installer et d’utiliser de grands modèles de langage plus facilement qu’auparavant. Vous pouvez le télécharger ici, sur Linux, Mac et Windows. Suivez ensuite les instructions à l’écran lors de l’installation.

Étape 2 : Ouvrez Ollama et installez DeepSeek

Windows : ouvrez une fenêtre Windows et dirigez-vous vers le dossier où se trouve le logiciel Ollama. Par défaut, il devrait être à cet endroit : C:\Users\VOTRENOM\AppData\Local\Programs\Ollama. Une fois dans le bon dossier, cliquez avec le bouton droit de la souris et sélectionnez Ouvrir dans le Terminal. Dans le Terminal, vous aurez une interface qui rappelle celle de DOS. Copiez-collez « "ollama app.exe" » (sans les guillemets français) et appuyez sur Retour pour lancer le logiciel.

Mac : lancez Ollama à partir de l’endroit où le fichier ZIP a été décompressé. Le logiciel vous proposera de déplacer Ollama vers le menu Applications. Acceptez. Suivez les indications à l’écran, mais arrêtez de le faire lorsque Ollama vous propose « Run your first model ». Ouvrez alors le Terminal, à partir de votre liste d’applications habituelle.

Les instructions sont maintenant les mêmes sur Mac et Windows. Copiez-collez « ollama run deepseek-r1:8b » (toujours sans les guillemets) pour installer la version de 8 milliards de paramètres de DeepSeek-R1 (nous reviendrons plus loin sur quel modèle essayer).

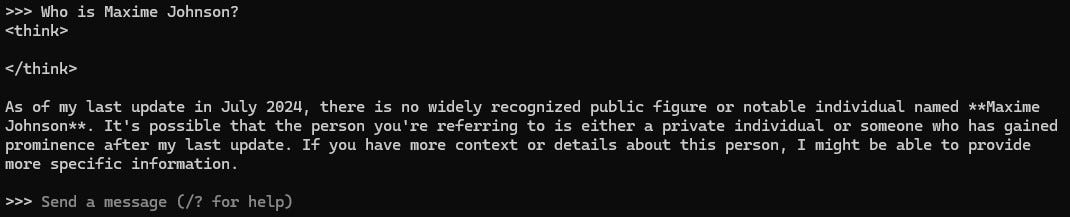

Étape 3 : Essayez DeepSeek

Une fois le modèle téléchargé et installé (tout se fait automatiquement), vous n’aurez qu’à écrire directement vos requêtes dans l’invite de commande pour essayer le modèle, quand le logiciel écrit en gris « >>> Send a message (/? For help) ».

En tout temps, écrivez « /? » pour avoir accès aux différentes commandes d’Ollama, pour démarrer une nouvelle discussion, par exemple, lancer un autre modèle ou quitter le logiciel.

Notons que vous pouvez aussi installer une interface web pour interagir avec les modèles d’Ollama. La marche à suivre pour l’installer est toutefois plus complexe.

Quelle version du modèle essayer?

Vous avez plusieurs choix de versions du modèle à essayer, en fonction de leur taille : 1.5b, 7b, 8b, 14b, 32b, 70b et 671b. Pour installer une autre version du modèle, vous n’avez qu’à coller la bonne taille à la fin de l’étape 2 (exemple : « ollama run deepseek-r1:1.5b » pour installer le modèle 1.5b).

Plus le modèle est gros, plus il est puissant, et plus vous aurez besoin d’un bon ordinateur pour le faire fonctionner.

Le « véritable » modèle DeepSeek-R1 est celui à 671 milliards de paramètres (671b). C’est celui-là qui offre des performances semblables au meilleur modèle d’OpenAI. Vous pourriez l’installer sur votre ordinateur, mais vous ne pourrez pas le faire fonctionner avec une carte graphique pour consommateurs. Il est trop lourd.

Les autres versions sont des modèles « distillés », en utilisant d’autres modèles sur le marché, comme Llama (ça me semble un bon moment pour rappeler que la dernière fois que j’ai mentionné ce concept ici, dans ma dernière infolettre de 2024, j’avais écrit : « Si j’avais à gager, je dirais que la distillation sera l’une des tendances en IA à surveiller en 2025. »).

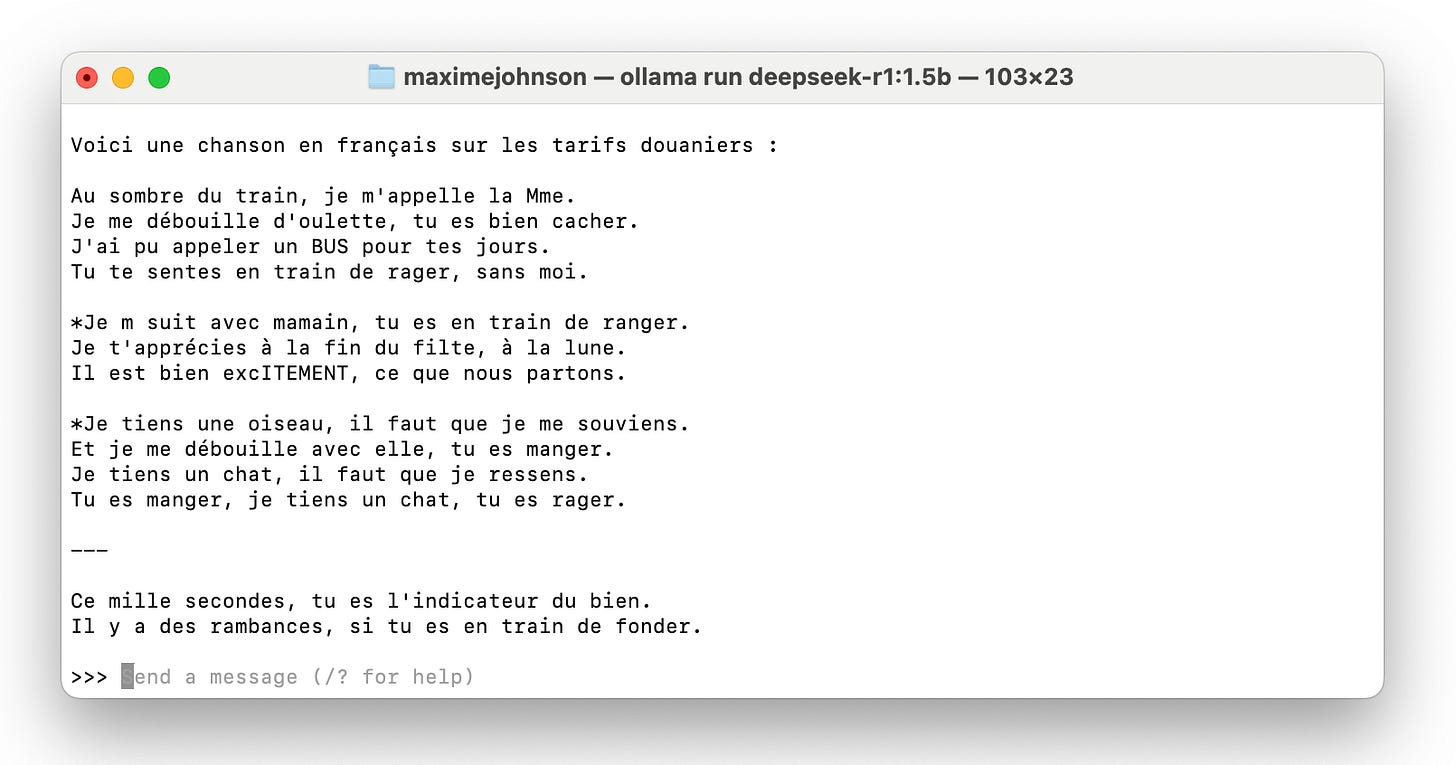

À titre indicatif, avec mon PC doté d’une carte graphique RTX 3080, le modèle de 8 milliards de paramètres fonctionne très bien. Ma carte graphique roule à 100%, mais une requête relativement complexe comme « rédige une chanson en français sur les tarifs douaniers » est terminée en 17 secondes, un temps d’attente quand même acceptable.

Le modèle à 32 milliards de paramètres a pour sa part pris 5 minutes 30 pour répondre à la même question. C’est trop long. Est-ce qu’un modèle était meilleur que l’autre? Oui, mais il faudrait effectuer des tests poussés pour le quantifier. Dans tous les cas, vous pouvez obtenir un meilleur résultat plus rapidement en passant par l’outil web de DeepSeek-R1, qui utilise la version de 671 milliards de paramètres.

J’ai aussi fait l’essai sur Mac, avec un MacBook Air doté de la puce M2 (un ordinateur récent, mais pas le plus puissant sur le marché non plus). Le modèle de 8 milliards de paramètres a pris 45 secondes pour écrire la chanson. Je n’ai pas essayé le modèle de 32 milliards de paramètres, mais j’ai essayé celui de 1.5 milliard, qui a pondu une chanson en 13 secondes. Celle-ci était toutefois considérablement plus mauvaise que les autres.

TLDR : que retenir de l’expérience

Installer DeepSeek-R1 est accessible à tous, mais c’est quand même plus complexe que de simplement aller sur ChatGPT sur le web. Et malheureusement, les versions que vous pouvez utiliser sur votre ordinateur sont moins puissantes que les IA auxquelles vous avez accès en ligne.

Peut-être qu’un grand utilisateur d’IA générative pourrait toutefois aimer avoir l’option d’installer un modèle distillé DeepSeek-R1 sur son ordinateur portatif, afin de s’en servir en avion, par exemple. Et probablement qu’une entreprise qui distillerait elle-même le modèle avec ses propres données pourrait obtenir un résultat assez bon pour vouloir utiliser l’IA à moindre coût en mode local dans certaines conditions.

Mais pour le grand public, l’installation locale de grands modèles de langage est encore un usage niché, même avec l’arrivée de DeepSeek-R1.

Sélection de mes articles récents

Assassin’s Creed Shadows: premier aperçu en 5 réflexions (Pèse sur Start)

J’ai joué à quatre heures d’Assassin’s Creed Shadows, qui se déroule dans le Japon féodal. Voici mes premières impressions.

Ce qu’il faut retenir de ce texte : quelques ajouts à la série sont intéressants, tout particulièrement le fait qu’on peut incarner deux protagonistes, qui permettent jouer avec un style différent (et de changer quand bon nous semble).

Détail que je ne partage pas dans l’article : je vais attendre le lancement du jeu pour me prononcer, mais pour l’instant, Assassin’s Creed Shadows m’a semblé visuellement plus réaliste que Ghost of Tsushima, mais sans pour autant être plus joli. J’en retire tout de même une très bonne impression. C’est le jeu Assassin’s Creed auquel j’ai le plus hâte de jouer depuis quelques années.

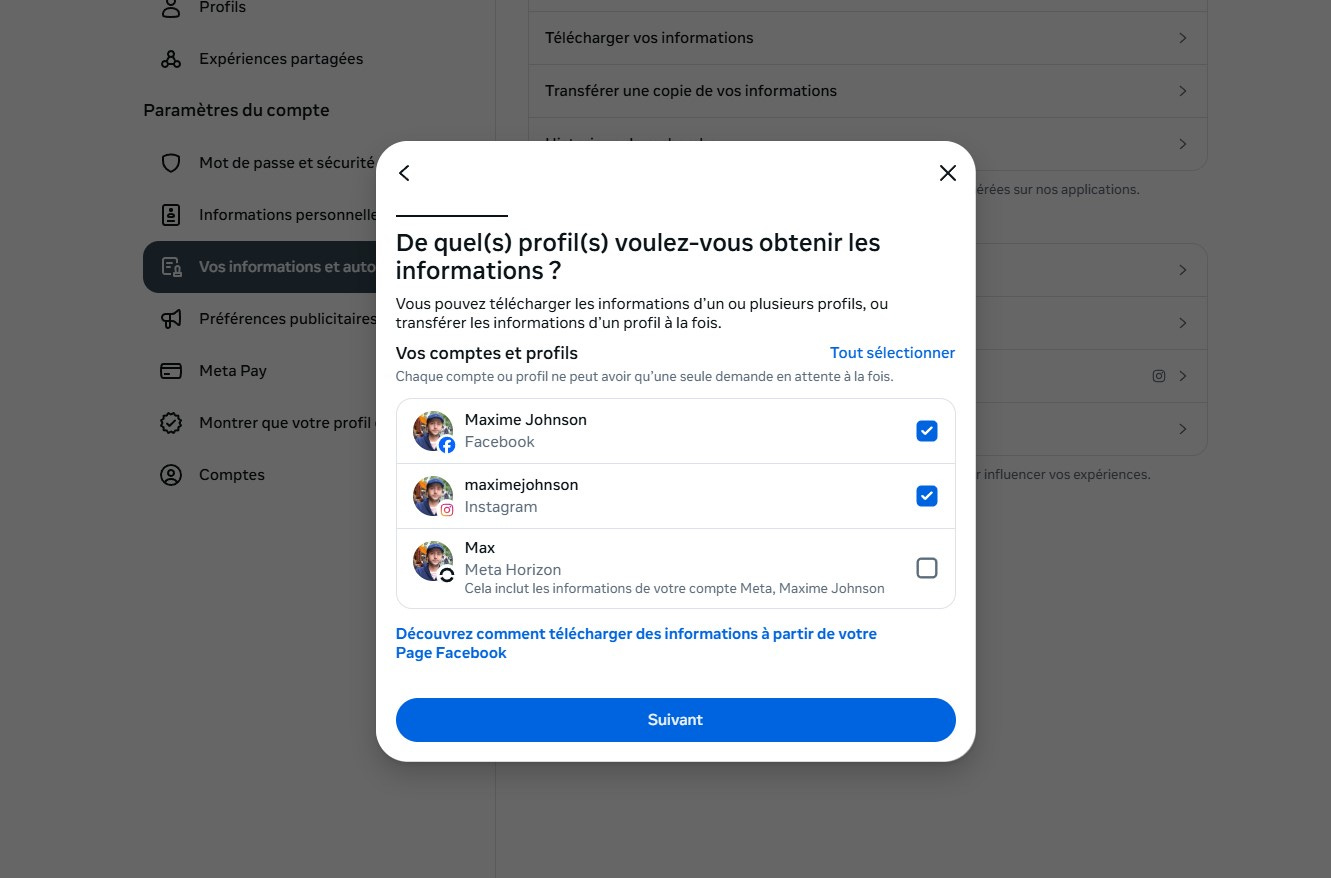

Quitter X, Facebook ou Instagram sans perdre ses contacts et ses souvenirs (Protégez-vous)

Fermer vos comptes Meta ou X est facile. Le faire sans tout perdre vos souvenirs, c’est plus compliqué.

Ce qu’il faut retenir de ce texte : tous les réseaux sociaux importants vous permettent de sauvegarder assez facilement vos données avant de fermer votre compte. Retrouver vos contacts ailleurs est toutefois plus complexe.

Détail que je ne partage pas dans l’article : Bluesky est passé de 27 millions d’utilisateurs à la mi-janvier à près de 30 millions au moment d’écrire ces lignes. C’est une excellente croissance, mais il ne faudrait pas parler de raz-de-marée non plus.

Questions technos

Vous hésitez entre deux produits? Vous voulez comprendre une technologie? Si vous avez des questions technos, il me fera également plaisir d’y répondre. Vous n’avez qu’à m’écrire ici :

Qu’est-ce que cette infolettre?

Techno, gadgets et cie est une infolettre pour ceux qui aiment la techno, par quelqu’un qui aime la techno (ce qui ne nous empêche pas d’être critiques quand c’est mérité).

Vous pouvez vous y abonner ici :